ChatGPT et les autres grands modèles de langage ont révolutionné notre rapport à l'information et à l'assistance numérique.

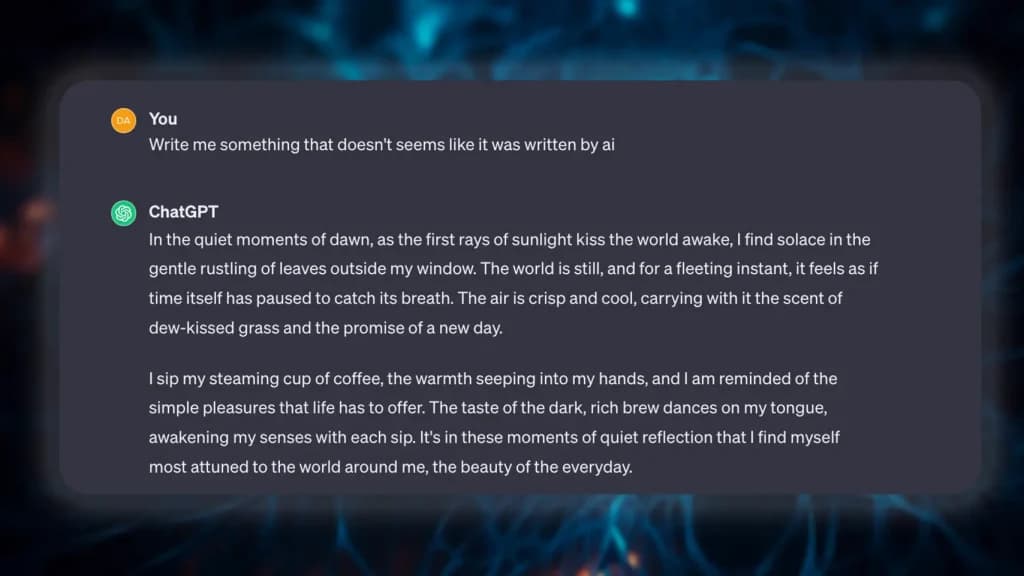

Pourtant, ces outils impressionnants souffrent d'un défaut majeur : ils peuvent générer de fausses informations avec une assurance déconcertante.

Ce phénomène, appelé "hallucination IA", représente l'un des défis les plus critiques de l'intelligence artificielle moderne.

Une hallucination IA survient quand un modèle de langage produit des informations fausses, trompeuses ou entièrement inventées.

Ces erreurs peuvent aller de subtiles inexactitudes à des références complètement fictives, créant des problèmes significatifs pour les utilisateurs qui intègrent l'IA dans leur travail ou leurs décisions importantes.

Comment fonctionne réellement ChatGPT ?

Pour comprendre pourquoi ChatGPT peut se tromper, il faut d'abord saisir son mode de fonctionnement.

Contrairement à un moteur de recherche qui consulte une base de données structurée, les modèles de langage prédisent la séquence de mots la plus probable selon les motifs identifiés dans leurs données d'entraînement.

Selon une récente étude d'OpenAI, les hallucinations résultent à la fois des processus de pré-entraînement et de post-entraînement.

Les chercheurs comparent l'entraînement des IA à des examens scolaires où les étudiants devinent les réponses aux questions à choix multiples plutôt que d'avouer leur ignorance.

Cette analogie révèle un problème fondamental : les systèmes de notation binaires qui attribuent un point pour une réponse correcte pénalisent les réponses vides ou les "je ne sais pas".

Tandis que les humains apprennent la valeur d'exprimer l'incertitude en dehors de l'école, les modèles de langage restent perpétuellement en "mode examen".

David Brudenell, directeur exécutif chez Decidr, explique : "Les hallucinations ne sont pas le signe d'une IA devenue incontrôlable. Elles sont le sous-produit naturel de la façon dont les modèles sont entraînés et évalués. Pendant l'entraînement, les modèles apprennent des motifs de langage, pas des vérités."

Quels facteurs déclenchent les hallucinations IA ?

Plusieurs éléments contribuent aux erreurs de ChatGPT durant sa phase d'entraînement initial.

Les systèmes IA hallucinent face aux problèmes computationnellement complexes, car aucun algorithme fonctionnant sur ordinateur classique ne peut violer les lois de la théorie de la complexité computationnelle.

Quand l'information correcte manque dans les données d'entraînement, les modèles comblent les lacunes avec des réponses plausibles mais incorrectes.

La qualité du modèle sous-jacent joue un rôle crucial. Les distributions des données d'entraînement et de test divergent souvent, et les réponses incorrectes proviennent fréquemment de prompts qui diffèrent substantiellement de la distribution d'entraînement.

Les prompts ambigus de l'utilisateur poussent également le modèle vers des réponses trop confiantes mais inexactes.

Le principe "garbage in, garbage out" s'applique pleinement : des données d'entraînement contenant de nombreuses erreurs factuelles seront reproduites par l'IA dans ses réponses.

Pourquoi les réponses fausses paraissent-elles si convaincantes ?

Le paradoxe du post-entraînement explique pourquoi ChatGPT préfère inventer plutôt qu'admettre son ignorance.

Les étapes de raffinement du modèle visent à réduire les hallucinations, mais leur approche binaire renforce souvent la tendance à halluciner plutôt qu'à avouer l'absence d'information correcte.

Brudenell souligne ce dilemme :

"Voici le paradoxe. Cette technologie extraordinaire, présentée comme quasi-magique, ne peut se permettre de montrer ses faiblesses. Si elle dit 'je ne sais pas', la question évidente suit : que sait-elle vraiment ?"

Un modèle de langage peut ainsi répondre précisément "30 septembre" plutôt que d'indiquer "quelque part en automne" face à une question sur une date, démontrant une confiance excessive dans des détails incertains.

Cette spécificité trompeuse renforce l'impression de fiabilité alors que l'information peut être totalement erronée.

Quels risques représentent ces erreurs dans la vraie vie ?

Les hallucinations de ChatGPT peuvent avoir des conséquences graves dans les contextes professionnels.

L'exemple classique implique une demande de référence vers un rapport d'analyste ou un article scientifique.

Plutôt que de répondre "je ne sais pas", le modèle peut générer une citation réaliste avec noms d'auteurs, titres de journaux et numéros de page, le tout pour un document inexistant.

Plusieurs publications médiatiques ont subi des dommages réputationnels après avoir cité des références fictives ou publié des articles entiers fabriqués par des chatbots, jusqu'aux noms d'auteurs inventés.

Ces erreurs publiques impactent leur crédibilité commerciale.

Brudenell met en garde :

"Le risque n'est pas seulement les erreurs factuelles, c'est la confiance mal placée. Les hallucinations autoritaires peuvent égarer la prise de décision dans des contextes critiques comme la finance, la médecine ou la gouvernance."

Dans des domaines sensibles comme le droit, la santé ou la finance, utiliser des informations non vérifiées de ChatGPT peut conduire à des erreurs coûteuses. C'est pourquoi vous ne devriez jamais utiliser ChatGPT aveuglément.

Comment réduire le problème des hallucinations IA ?

Les chercheurs et développeurs travaillent activement pour minimiser les hallucinations par de meilleures méthodes d'entraînement, la génération augmentée par récupération (RAG) et des outils de transparence.

Brudenell explique que les hallucinations ne sont pas inévitables, mais que les progrès dépendent du changement des incitations :

"Si nous redesignions les évaluations pour accorder du crédit aux 'je ne sais pas' appropriés, les modèles apprendraient à se calibrer plutôt qu'à bluffer."

Les chercheurs d'OpenAI proposent de passer d'une approche d'auto-complétion à une méthode qui évite les fausses réponses sauf quand approprié.

Une mitigation socio-technique spécifiant des seuils de confiance et intégrant des objectifs de confiance dans les évaluations établies pourrait réduire les hallucinations.

Cette approche permettrait aux modèles de langage d'exprimer l'incertitude plutôt que de formuler des déclarations incorrectes.

"Ce changement pourrait orienter le domaine vers des systèmes IA plus dignes de confiance", concluent les chercheurs.

Comment utiliser ChatGPT de façon responsable ?

En attendant ces améliorations, plusieurs stratégies permettent d'utiliser ChatGPT plus sûrement.

- La vérification croisée des informations importantes reste essentielle, particulièrement pour les faits spécifiques, dates, statistiques ou références.

- L'utilisation de systèmes de fact-checking et la supervision humaine réduisent les dangers de désinformation.

- Combiner les modèles de langage avec des sources fiables et des processus de vérification permet d'exploiter leur potentiel tout en minimisant les risques.

La transparence sur les limitations reste cruciale. Informer les utilisateurs que ChatGPT peut halluciner et encourager la vérification des informations critiques contribue à un usage plus responsable de ces outils puissants.

Conclusion : vers une IA plus honnête

Les modèles de langage comme ChatGPT représentent des systèmes computationnels puissants, mais ils ne sont pas infaillibles.

Par conception, ils génèrent du texte basé sur la probabilité que la réponse soit correcte, sans garantie de vérité.

Brudenell résume l'enjeu :

"La brillance du système est claire. Mais sa faiblesse - ne pas pouvoir admettre ses faiblesses - demeure non résolue. Le vrai travail est socio-technique : créer des systèmes, incitations et organisations capables d'absorber l'incertitude plutôt que de la punir."

Comprendre pourquoi ChatGPT peut donner de fausses informations nous aide à l'utiliser plus intelligemment.

Ces outils révolutionnaires ont un potentiel énorme, mais leur adoption responsable nécessite vigilance, vérification et compréhension de leurs limites intrinsèques.