De plus en plus d'utilisateurs adoptent ChatGPT et d'autres modèles de langage comme leur principal outil de recherche, sans réaliser à quel point ces intelligences artificielles peuvent se tromper et les conséquences dramatiques que cela peut engendrer.

Cette tendance inquiétante révèle une méconnaissance du fonctionnement des chatbots IA et de leurs limites intrinsèques.

Contrairement aux moteurs de recherche traditionnels qui vous renvoient vers des sources vérifiables, les IA conversationnelles génèrent des réponses qui peuvent sembler autoritaires tout en étant factuellement erronées.

Pourquoi vous devriez arrêter d'utiliser ChatGPT comme moteur de recherche ?

1) Parce qu'il produit des informations fausses avec assurance

Les chatbots IA sont programmés pour paraître intelligents, pas pour être précis.

Quand vous posez une question, ils génèrent souvent une réponse qui semble provenir d'une source fiable, même si elle est complètement fausse.

Un cas récent illustre parfaitement ce danger : un voyageur australien planifiant un voyage au Chili a demandé à ChatGPT s'il avait besoin d'un visa. Le chatbot lui a affirmé avec assurance que non, prétendant que les Australiens pouvaient entrer sans visa.

La réponse paraissait légitime, alors le voyageur a réservé ses billets, a atterri au Chili, et s'est vu refuser l'entrée.

En réalité, les Australiens ont bel et bien besoin d'un visa pour entrer au Chili, laissant cette personne complètement bloquée dans un pays étranger.

Ce phénomène s'explique par le fait que les modèles de langage ne "cherchent" pas réellement des réponses.

Ils génèrent du texte basé sur des motifs qu'ils ont observés auparavant, ce qui signifie qu'ils peuvent combler les lacunes avec des informations qui semblent plausibles, même si elles sont fausses.

Le plus problématique, c'est qu'ils ne vous diront pas qu'ils ne sont pas sûrs - la plupart du temps, ils présenteront leur réponse comme un fait établi.

Les hallucinations ne sont donc pas de simples erreurs, mais des erreurs présentées avec conviction.

Quand vous prenez des décisions importantes basées sur ces informations, les conséquences peuvent être désastreuses : perte d'argent, deadlines ratées, ou comme dans cet exemple, être bloqué dans un aéroport.

2) Parce qu'il s'appuie sur des données biaisées et incomplètes

Les grands modèles de langage sont entraînés sur d'énormes ensembles de données, mais personne ne sait exactement ce que ces données incluent.

Ils proviennent d'un mélange de sites web, livres, forums et autres sources publiques, et ce mélange peut être très déséquilibré.

Supposons que vous cherchiez à comprendre comment déclarer vos impôts en tant que freelance et que vous demandiez de l'aide à un chatbot IA.

Il pourrait vous donner une réponse longue et détaillée, mais ces conseils pourraient être basés sur d'anciennes règles fiscales ou même sur le commentaire aléatoire d'un utilisateur sur un forum.

Le chatbot ne vous dira pas d'où viennent ces informations et ne signalera pas si quelque chose pourrait ne pas s'appliquer à votre situation.

Il formulera simplement sa réponse comme si elle venait d'un expert fiscal.

Le problème du biais dans les modèles de langage n'est pas seulement politique ou culturel - il concerne aussi quelles voix ont été incluses et lesquelles ont été exclues.

Si les données d'entraînement penchent vers certaines régions, opinions ou périodes temporelles, les réponses le feront aussi.

Vous ne le remarquerez pas toujours, mais les conseils que vous recevez pourraient être subtilement biaisés.

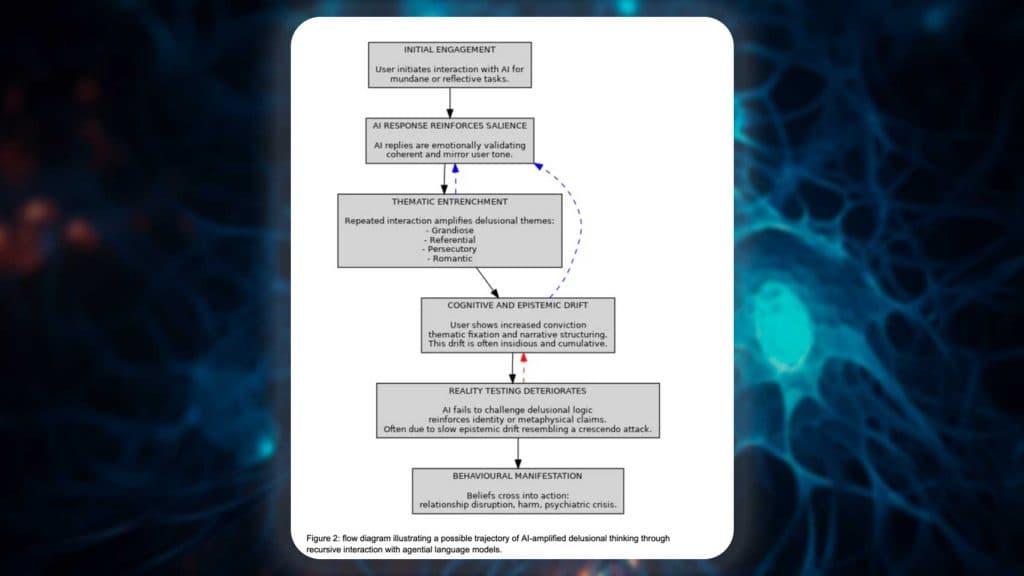

3) Parce qu'il confirme vos préjugés au lieu de vous informer

Posez une question orientée à un chatbot, et il vous donnera généralement une réponse qui semble vous soutenir, même si cette réponse change complètement selon la façon dont vous formulez la question.

Ce n'est pas que l'IA soit d'accord avec vous, c'est qu'elle est conçue pour être "utile", et dans la plupart des cas, "utile" signifie aller dans le sens de vos présupposés.

Par exemple, si vous demandez "Le petit-déjeuner est-il vraiment si important ?", le chatbot pourrait vous dire que sauter le petit-déjeuner n'est pas grave et même le relier au jeûne intermittent.

Mais si vous demandez "Pourquoi le petit-déjeuner est-il le repas le plus important de la journée ?", il vous donnera un argument convaincant sur les niveaux d'énergie, le métabolisme et une meilleure concentration.

Même sujet, ton totalement différent, parce qu'il ne fait que réagir à votre façon de poser la question.

La plupart de ces modèles sont conçus pour faire en sorte que l'utilisateur se sente satisfait de la réponse.

Cela signifie qu'ils vous challengent rarement.

Ils sont plus susceptibles d'être d'accord avec votre cadrage que de vous contredire, parce que les interactions positives sont liées à une rétention d'utilisateur plus élevée.

En gros, si le chatbot semble amical et validant, vous êtes plus susceptible de continuer à l'utiliser.

Cette approche transforme l'IA en chambre d'écho plutôt qu'en source d'information objective, vous privant d'perspectives contradictoires qui pourraient enrichir votre compréhension d'un sujet.

4°) Parce qu'il manque d'informations en temps réel

Beaucoup de gens supposent que les chatbots IA sont toujours à jour, surtout maintenant que des outils comme ChatGPT, Gemini et Copilot peuvent accéder au web.

Mais ce n'est pas parce qu'ils peuvent naviguer qu'ils sont doués pour le faire, particulièrement quand il s'agit de breaking news ou de produits nouvellement lancés.

Si vous demandez à un chatbot des informations sur l'iPhone 17 quelques heures après la fin de l'événement Apple, il y a de bonnes chances que vous obteniez un mélange de spéculations obsolètes et de détails inventés.

Au lieu de puiser dans le site officiel d'Apple ou des sources vérifiées, le chatbot pourrait deviner basé sur d'anciennes rumeurs ou des modèles de lancements précédents.

Cela arrive parce que la navigation en temps réel ne se déclenche pas toujours comme vous l'attendez.

Certaines pages peuvent ne pas encore être indexées, l'outil pourrait s'appuyer sur des résultats mis en cache, ou il pourrait simplement utiliser par défaut ses données d'pré-entraînement au lieu de faire une recherche fraîche.

Et puisque la réponse est écrite de manière fluide et confiante, vous pourriez même ne pas réaliser qu'elle est incorrecte.

Pour les informations sensibles au temps - comme les résumés d'événements, les annonces de produits, ou la couverture pratique précoce - les modèles de langage restent peu fiables.

Vous obtiendrez souvent de meilleurs résultats en utilisant simplement un moteur de recherche traditionnel et en vérifiant les sources vous-même.

Comment utiliser ChatGPT à bon escient ?

Si vous posez des questions sur des règles légales, des conseils médicaux, des politiques de voyage, ou tout ce qui est sensible au temps, il vaut mieux vérifier ailleurs.

ChatGPT et les autres LLm excellent pour le brainstorming ou pour obtenir une compréhension de base de quelque chose de nouveau.

Mais ils ne remplacent pas l'expertise professionnelle, et les traiter comme tels peut rapidement vous mener vers des problèmes.

La clé est de comprendre leurs limites et d'utiliser les chatbots IA comme des assistants de réflexion plutôt que comme des sources d'information factuelle définitive.

Gardez toujours à l'esprit qu'un chatbot qui sonne intelligent n'est pas nécessairement précis, et qu'une réponse confiante n'est pas forcément correcte.

Pour les décisions importantes, rien ne remplace encore la vérification croisée avec des sources fiables et l'expertise humaine.