La math est brutale. Si ton agent est fiable à 95% par étape, une chaîne de 100 actions te donne un taux de succès global de 0,6%. Pas 60%. Pas 6%. 0,6%.

C'est le problème structurel qu'OpenServ prétend avoir résolu avec SERV Reasoning, et les benchmarks publiés valent qu'on les regarde de près.

Le réflexe qui ne marche pas

La réponse de l'industrie au problème de fiabilité des agents, c'est d'acheter un modèle plus gros. Haiku ne tient pas ? Passe à Sonnet. Sonnet flanche ? Opus. Attends GPT-6.

Ça ne règle rien, et la raison est structurelle : un LLM ne raisonne pas, il prédit le prochain token. Une hallucination dans le contexte ne disparaît pas, elle se propage. Le modèle construit sur l'erreur, l'erreur grossit, et à l'étape 47 tu as un agent qui prend des décisions sur des prémisses corrompues depuis l'étape 3. Un modèle plus intelligent fait la même chose, juste avec un vocabulaire plus riche.

Le bottleneck n'est pas le QI du modèle. C'est l'architecture de raisonnement entre les étapes.

Graph-based prompting vs chain-of-thought

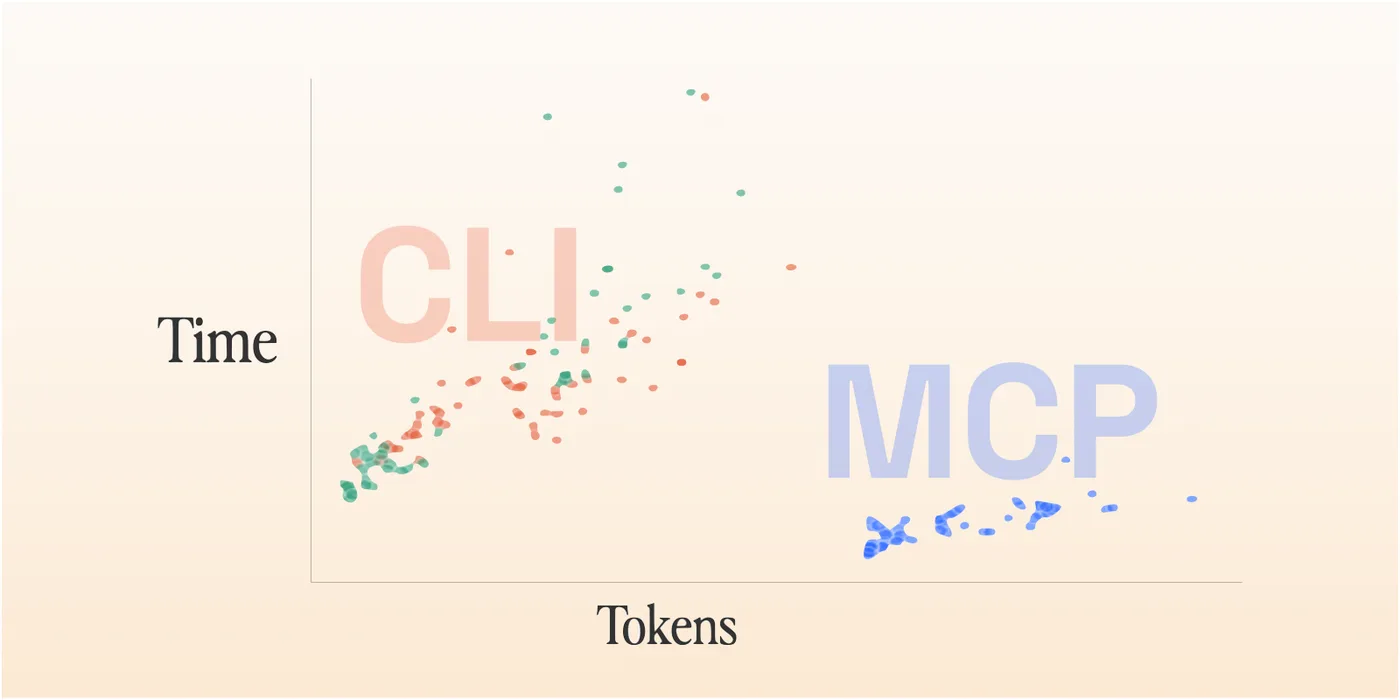

Le chain-of-thought classique laisse le modèle penser librement étape par étape. Il explore, il dérive, il revient, il repart. Tu paies chaque token de ce voyage, y compris les culs-de-sac.

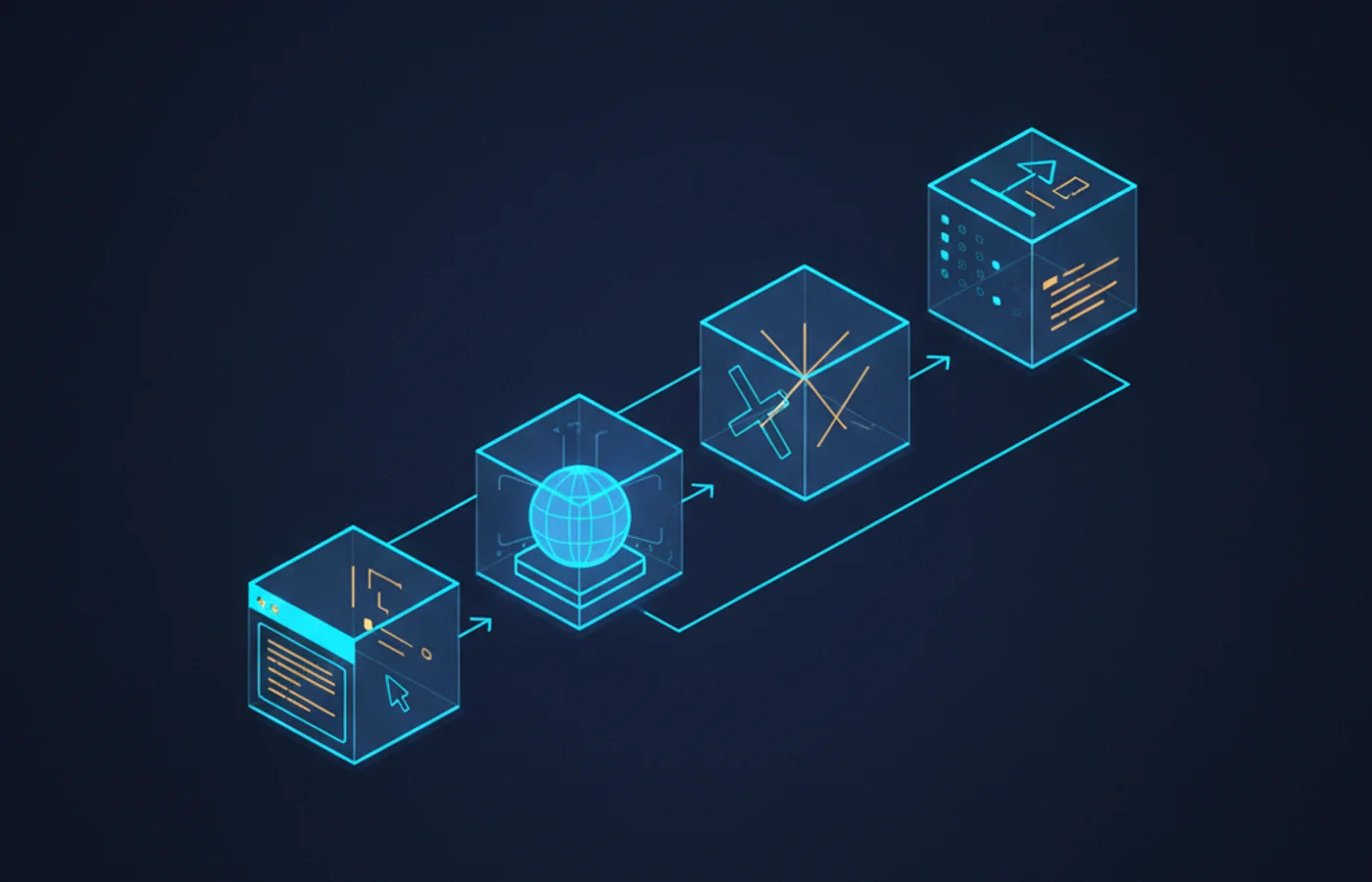

SERV Reasoning remplace ça par du graph-based prompting structuré. Le raisonnement est contraint dans des chemins explicites avec des frontières définies. Le modèle ne dérive pas, il suit un graphe de décision. Quand un chemin est fermé, c'est fermé.

Le résultat publié : des modèles moins chers augmentés avec SERV Reasoning atteignent ou dépassent les modèles frontier sur les benchmarks de raisonnement. GPT-5 level de performance à environ 74x moins cher selon leurs chiffres. Ce sont des résultats reproductibles publiés, pas des claims marketing.

Ce qui donne du crédit aux chiffres

L'équipe derrière OpenServ a commencé à builder début 2023, avant que "AI agents" devienne une catégorie crypto. Les profils : NVIDIA, Amazon AI, J.P. Morgan, TRON, avec Dr. Eyup Cinar à la recherche (40+ papers académiques en deep learning). Armagan Amcalar et Tim Hafner complètent le trio fondateur.

Ce qui distingue ce projet du narratif habituel, c'est la production réelle. Pas un MOU, pas un pilote en sandbox : un déploiement live avec le gouvernement des UAE via Neol. C'est le type de validation qui ne s'invente pas.

La stack complète couvre build, launch et run : outils purpose-built pour le développement d'agents, accès au capital, orchestration native avec gestion de la mémoire, communication inter-agents, coordination et handoff. C'est ce que Virtuals et les frameworks classiques ne font pas, chacun s'arrêtant à une couche.

On avait creusé les premiers benchmarks SERV-nano contre GPT-5.4 quand ils sont sortis. Ce qui s'ajoute ici : la math du bottleneck exposée clairement, les données UAE, et l'ouverture de la beta privée.

Ce que ça change si tu construis des agents aujourd'hui

Le problème des 0,6% te concerne dès que tes chaînes dépassent 15-20 étapes. Pas dans 6 mois quand tu voudras scaler.

La coordination entre agents est l'endroit où tout se casse, pas la qualité du modèle individuel. On l'a documenté sous un angle différent dans notre analyse sur les agents marketing autonomes.

Avant de doubler ta facture Anthropic pour passer à Opus, auditer ton architecture de raisonnement est probablement le meilleur investissement de ta semaine. La vraie question n'est pas si SERV Reasoning tient ses promesses à 122x, c'est si l'approche graph-based est la bonne réponse architecturale au problème de dérive en chaîne. Les benchmarks publiés suggèrent que oui. Le déploiement UAE confirme qu'il y a au moins une prod réelle qui tourne.