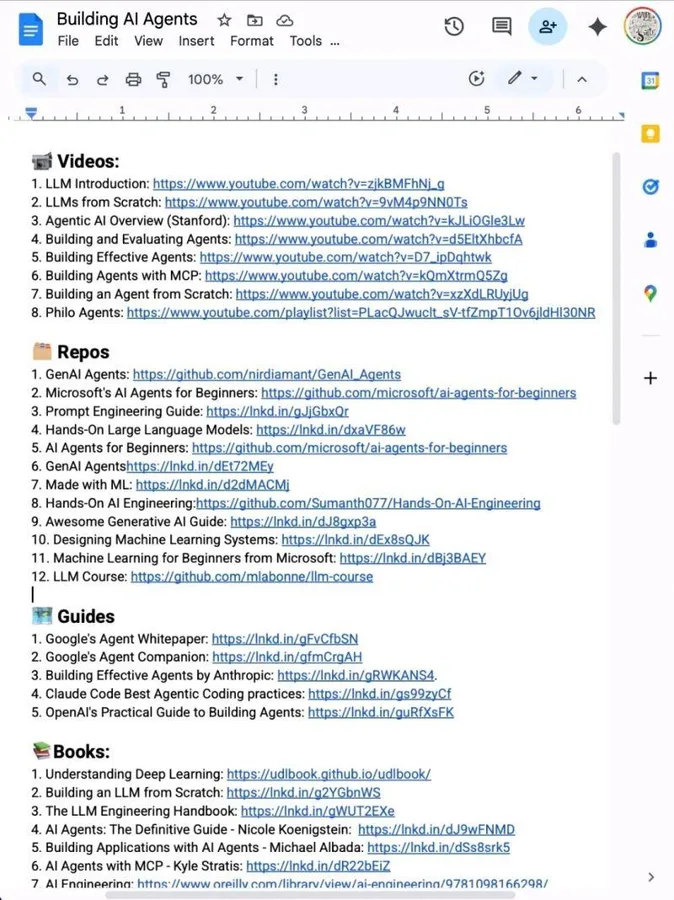

La plupart des ressources "apprends l'IA en 2025" sont du remplissage. Voici trois vidéos qui couvrent trois niveaux distincts, sans redondance entre elles.

Si tu n'as jamais ouvert un paper sur les LLMs

La vidéo LLM Introduction est le point d'entrée le moins douloureux que j'ai vu. Pas de maths lourdes au démarrage : le concept de token, d'attention et de génération autorégressive y est posé clairement en 45 minutes.

Si tu veux comprendre ce qui se passe sous le capot

LLMs from Scratch est dans la lignée du travail de @karpathy sur nanoGPT. Tu construis un transformer pièce par pièce. C'est là que tu comprends pourquoi le context window a un coût, pourquoi le fine-tuning exige du soin, pourquoi certaines architectures tiennent mieux que d'autres en production.

Si tu travailles déjà sur des agents

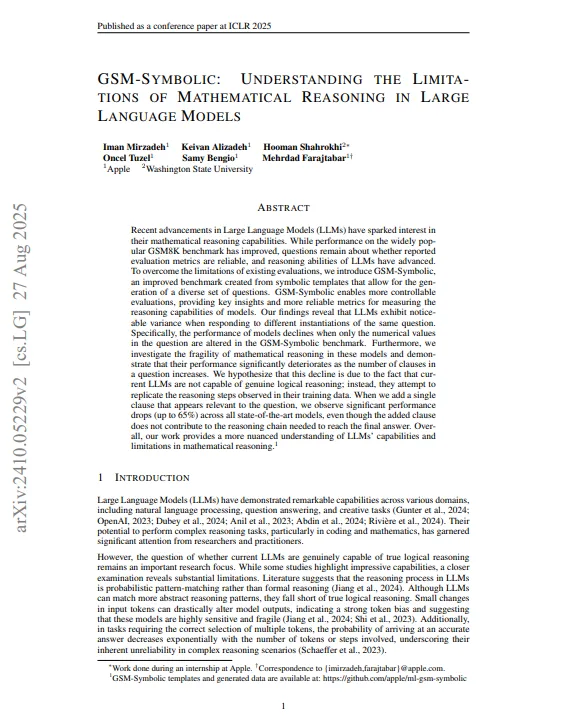

L'overview Stanford sur l'IA agentique couvre les patterns de planification, de mémoire et d'orchestration avec un niveau de rigueur qu'on ne retrouve pas dans les tutoriels YouTube habituels. C'est la ressource la plus utile des trois si tu buildes des workflows multi-agents. Pour aller plus loin sur l'architecture mémoire, on avait creusé la mémoire LLM explicite et ce qui change en 2025 dans un article dédié.